Как перевести древний сайт на HTTPS, адаптивный дизайн и CMS — «Вопрос-ответ» №41

10 актуальных вопросов от читателей и мои ответы на них — выпуск №41. Темы — Турбо.Страницы для интернет-магазинов, PBN, переезд на новую CMS, поиск автора под проект и другие. В содержании выбирайте понравившийся вопрос и кликайте на него.

Содержание:

- 1. Как надежно закрыть служебные поддомены от индексации?

- 2. Какой автор лучше: филолог/журналист или практик?

- 3. Как корректно распределить информационные и коммерческие запросы с разной частотностью?

- 4. Как работают сервисы по улучшению индексации?

- 5. На что ориентироваться: на динамику ссылающихся страниц или доменов?

- 6. Влияют ли сквозные элементы на ранжирование страницы?

- 7. Региональное продвижение поддоменами: сразу на все регионы или только на выбранные?

- 8. Нужно ли закрывать продвигаемый сайт от сканирования роботами Ahrefs, Majestiс и т.п.?

- 9. Как правильно перевести древний сайт на HTTPS, адаптивный дизайн и CMS?

- 10. После внедрения Турбо.Страниц для интернет-магазинов ничего не поменялось: что делать?

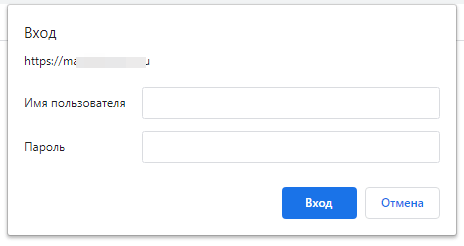

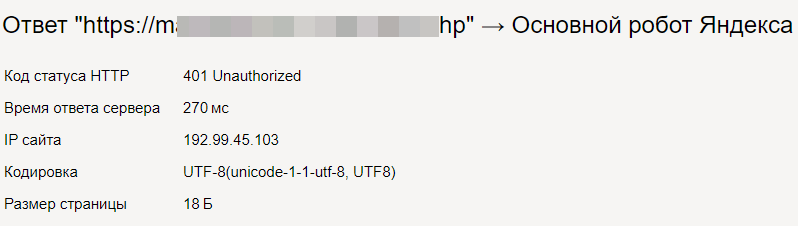

1. Как надежно закрыть служебные поддомены от индексации?

Привет, Серега! Мы студия по разработке сайтов (работаем как на готовых CMS, так и на своей). На поддоменах нашего основного домена сайта много разных проектов, от CRM до непосредственно клиентских ресурсов. Они не должны индексироваться, но постоянно, то один, то второй попадают в индекс. Уже пробовали и robots.txt, и canonical — не помогает. Как посоветуешь надежнее всего закрыть от индексации служебные поддомены?

Варианты по приоритету:

1) Вход на служебные домены лучше запаролить (вход только по логину/паролю).

В идеале, чтобы страницы отдавали 401 ответ — Unauthorized.

Альтернатива 401-ответу:

- X-Robots-Tag: noindex в рамках HTTP-заголовка;

- <meta name="robots" content="noindex, nofollow" /> в рамках тега HEAD.

2) Возможность входа только через определенные IP. Довольно надежный метод, но не совсем удобный, когда у пользователей динамический IP, нужно давать доступы удаленным сотрудникам и т.п.

3) X-Robots-Tag: noindex в рамках HTTP-заголовка (предпочтительно, страница в принципе не должна загрузиться поисковым роботом) или <meta name="robots" content="noindex, nofollow" /> в рамках тега HEAD (менее предпочтительно, потому что страница в данном случае загружается). Это минимально допустимый вариант, но не на 100% надежный в отличие от первых 2-х.

Закрытие страниц в robots.txt и тем более canonical (например, по документации Яндекс не понимает междоменный canonical, включая поддомены) я не рекомендую.

2. Какой автор лучше: филолог/журналист или практик?

В планах запуск сайта по тематике строительство. Подскажите, какой автор будет лучше? Тот, кто хорошо пишет (большой опыт в копирайтинге, филологическое образование, хорошая стилистика и тп) или тот, у которого есть опыт в строительстве, но попадаются стилистические ошибки, высокая спамность текстов?

Безусловно, тексты практика могут оказаться полезнее для пользователей, но они не всегда дотягивают до уровня качественного контента для поисковых систем. Варианты, как бы поступил я:

- Нашел бы практика, который и пишет хорошо.

- Средний практик и его прокачка (как вариант, курсы или собственное обучение на практике

) + подробнейшее ТЗ.

- Средний практик + редактор в виде условного филолога/журналиста. Последний поможет подтянуть текст, сделать его привлекательным и для пользователей, и для поисковиков.

3. Как корректно распределить информационные и коммерческие запросы с разной частотностью?

Сайт-салон красоты в Москве. Все ВЧ и СЧ — инфозапросы, коммерческие ключи с добавкой (цена, Москва) — НЧ. Можно:

- ВЧ — на категорию, СЧ — на подкатегорию, коммерческие НЧ ключи с добавкой (цена, Москва) — на подкатегорию?

- На ВЧ и СЧ — ставим топоним (в Москве)?

- Или весь рабочий сайт — только коммерческие НЧ, а все ВЧ и СЧ — в блог. Конечно, не хотелось бы так. Рассуждаю, что коммерческие НЧ находясь в одном кластере с ВЧ и СЧ — усиливаются за счет полноты СЯ. Да и структура SILO.

Эффективнее определять тип страницы запросу, изучая выдачу. Если, например, по инфо-запросам в выдаче преимущественно информационные страницы, то лучше оптимизировать под такой запрос именно инфо-страницу. Коммерческие страницы по ним могут в принципе не ранжироваться.

Дополнительно если на сайте вперемешку будут и информационные и коммерческие страницы, то это может негативно сказаться на юзабилити.

Классический вариант — распределение коммерческих запросов по коммерческим страницам, исходя из частотности, конкуренции и т.п. Под информационные же запросы создается отдельный раздел с инфоконтентом.

4. Как работают сервисы по улучшению индексации?

Встретил один сервис, который якобы помогает индексировать страницы. Его суть заключается в том, чтобы добавить ссылки на непроиндексированные страницы, а он их начинает по очереди открывать в твоем же браузере

. Это какой-то троллинг или действительно помогает?

Данные сервисы работают исходя из философии, что поисковые системы (как Яндекс, так и Google) могут брать данные по новым непроиндексированным страницам из собственных браузеров (Яндекс.Браузер и Google Chrome, соответственно). Раз кто-то зашел на страницу, то значит она может быть важная — нужно добавить в индекс. Сервисы как раз и просят работать с ними только из этих браузеров.

Зачастую это и правда помогает добавить в индекс страницы, которых до этого там не было. Усилить эффект поможет:

- обращения к документам по разным IP (например, с помощью поиска исполнителей на биржах фриланса);

- привязка счетчика Яндекс.Метрики к Яндекс.Вебмастеру + разрешение на обход. Здесь нужно быть уверенным, что все мусорные/служебные документы запрещены к индексации.

5. На что ориентироваться: на динамику ссылающихся страниц или доменов?

Продвигаем сайт. Стараемся плавно создавать ссылочную массу. Если по доменам-донорам график можно считать плавным, то по ссылающимся страницам получился ссылочный взрыв с последующим планомерным падением.

Важна ли динамика ссылающихся страниц или ориентироваться только на домены?

На мой взгляд, смотреть стоит именно на ссылающиеся сайты, а не документы. Графики ссылающихся страниц подвержены сильным колебаниям. Поставили несколько баннеров/сквозных ссылок на больших проектах — получили 1КК+ входящих линков. Сняли рекламу — минус 1КК линков .

На синем графике до конца 2018 практически идеальная картина. Потом 2 довольно сильных, но не критичных всплеска (скорее всего, подклеивали сайты 301-редиректом).

6. Влияют ли сквозные элементы на ранжирование страницы?

Насколько влияют фрагменты на странице на ранжирование? Есть какие-то данные по этому? Например, текст, там условно 3000 збп. А есть еще фрагменты (меню, ссылки, футер, хедер) на еще 3500 збп суммарно (там тоже встречаются ключи). Учитывают ли ПС это? Ты сам при продвижении на них опираешься? Или это не так важно?

Да, должны учитывать, но могут учитывать с дисконтом (поисковики умеют разделять основные/сквозные элементы). То есть эти 3000 знаков без пробелов основного контента важнее тех 3500 сквозного. То же самое и про сквозные линки и ссылки из основного контента.

На сквозные элементы опираюсь: слежу, чтобы там было все релевантно, не спамно, не громоздко, без больших включений текста. Но при анализе текста опираюсь именно на основной контент.

Есть вариант работы с сайдбаром, шапкой и подвалом, когда они не повторяются от страницы к странице, но там немного сложнее . По важности получится что-то среднее между основным контентом на странице и сквозным.

7. Региональное продвижение поддоменами: сразу на все регионы или только на выбранные?

Приветствую, Сергей! Клиент хочет зайти в регионы (лучше там ранжироваться), но реальный филиал только в Москве. Я ему предложил идею с региональным поддоменами в Яндексе. Вопрос, как сделать: масштабно сразу на все желаемые регионы (в списке 80 городов), города-миллионники или какой-то другой вариант?

Я бы посоветовал сначала для тестов раскатать идею на 1-2 крупных регионах (например, Санкт-Петербург, Екатеринбург). Во-первых, это даст опыт и понимание, а стоит ли оно того. Во-вторых, при региональном продвижении поддоменами есть много нюансов и их лучше отточить на меньшем количестве ресурсов, чтобы потом не исправлять везде.

После удачного внедрения каждый месяц добавлять по несколько новых регионов, то есть делать постепенно.

8. Нужно ли закрывать продвигаемый сайт от сканирования роботами Ahrefs, Majestiс и т.п.?

В стратегии линкбилдинга есть PBN (довольно существенная часть). PBN через .htaccess запрещено сканировать роботам ахрефс, маджестик и другим ссылочным краулерам. А стоит ли основной продвигаемый сайт закрывать от сканирования?

Основная задача такого запрета — не показывать конкурентам, откуда ведут ссылки на продвигаемый сайт. Если же запретить и его сканирование, то краулеры не будут знать, куда с него ставят ссылки (+ еще некоторые данные).

То есть можно закрыть и основной сайт, но это мероприятие не закроет от конкурентов всю статистику по нему. Они будут по-прежнему видеть данные по трафику, ссылкам (помимо тех закрытых PBN). То есть ощутимых выгод, на мой взгляд, этот запрет не принесет.

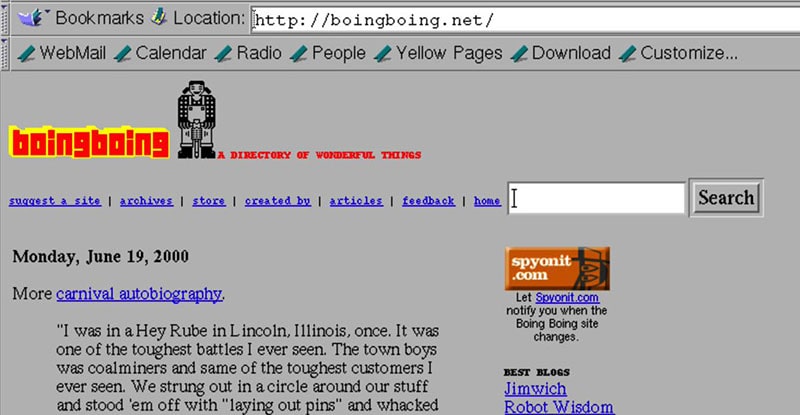

9. Как правильно перевести древний сайт на HTTPS, адаптивный дизайн и CMS?

На разработку и SEO попал древний сайт. Прямо-таки динозавр рунета, но с хорошей посещаемостью, более 10.000 в сутки из поиска. Нам нужно:

- перейти на https;

- перейти на новый дизайн с адаптивной версткой;

- поменять CMS.

Как лучше сделать: поочередно (если да, то в какой последовательности) или сразу все скопом?

Я бы советовал разбить перенос на 2 части:

- Перенос сайта на новую CMS и адаптивный дизайн (можно одновременно);

- После того, как устаканится поисковая посещаемость — переход на https.

Так будет наиболее безопасно. Поисковые системы не любят цепочек редиректов, а, например, в случае с одновременным переходом на новую CMS с https их, скорее всего, не избежать = Old URL -> New URL -> HTTPS New URL.

10. После внедрения Турбо.Страниц для интернет-магазинов ничего не поменялось: что делать?

По наставлениям Яндекса решили поставить Турбо.Страницы для интернет-магазина. Читал, ты писал, что может просесть конверсия, но это было 1,5 года назад. Решили рискнуть, все-таки с тех пор в коммерческие турбо добавили много нового функционала.

Установили несколько месяцев назад. Ждали роста трафика с Яндекса и падение конверсии с него же. Результат получился неожиданным: и по трафику, и по конверсиям ничего не поменялось. Теперь думаем, что делать. Сносить турбо (это отдельный сайт, считай, разрабатывай) или оставлять? Подскажи, пожалуйста, как ты считаешь?

Результат, действительно, получился интересным. Возможно, поисковый трафик с Яндекса как-то наглядно изменился именно с мобильных устройств. Также могли быть изменения в позициях.

В любом случае Яндекс сейчас активно продвигает Турбо-технологии и, хочешь не хочешь, приходится подстраиваться (в адекватных рамках, конечно). Я бы оставил как есть и продолжил наблюдения.

Есть ли смысл дорабатывать сайт, когда он в топе?

Есть ли смысл дорабатывать сайт, когда он в топе?  Какой CTR в контекстной рекламе считается нормальным?

Какой CTR в контекстной рекламе считается нормальным?

Спасибо за ответы!

Отличные ответы, спасибо! Хочу добавить, что для индексации также хорошо помогают социальные сети, их сигналы с активных профилей.

А реально полезная статья, спасибо. Вопрос этот точно у многих возникает..